更具颠覆性的是,这两个区间并非孤立存在。

Letta的技术支持对某一个「记忆块」进行单点更新,随后数十万智能体的行为便会随之改变。

这意味着,AI个体之间的「经验」是可共享的。

正如 Bilt 的工程师 Andrew Fitz 所说:

「我们可以通过一次更新,就让整个系统的表现发生连锁变化。」

根据Letta的介绍,该机制采用的是「主代理+睡眠代理」的架构。

前者负责实时交互,后者在后台持续整理记忆,把信息写入共享的memory blocks,让AI在「醒来」后拥有更清晰、更稳定的认知。

对此,Fast Company评论道:

这不仅是模仿人类的梦境,更是「主动智能」(proactive intelligence) 的雏形。

AI 不再只是被动回答,而是在睡眠中提前优化推理策略。

实验显示,在数学和逻辑测试中,应用睡眠计算的模型表现更好,推理时间和成本也显著下降。

如果说人类的梦境是私密的,那AI的「睡眠记忆」更像是一场同步的大规模演练。

从健忘到记忆

AI的短板与突围

越来越多的用户抱怨AI健忘、答非所问,甚至编造「回忆」。

不少研究者认为,记忆缺陷是限制AI智能与稳定的根源。

如果没有稳定可靠的记忆,AI无法形成真正的个性化与长期价值。

也正因如此,「提高记忆力」成为行业的集体突围方向。

LangChain的CEO Harrison Chase把记忆视为「上下文工程的核心」。

他认为,AI的智能很大程度取决于开发者选择放进上下文的信息。

LangChain因此提供了不同的记忆存储机制,从用户长期画像到近期交互记录,都能灵活调用。

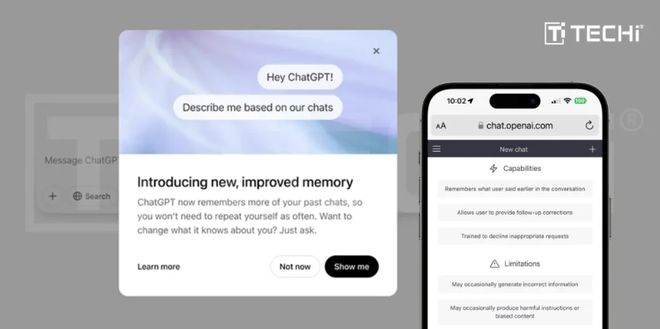

对此,OpenAI也在尝试。

今年2月,它宣布ChatGPT将具备记忆功能,能在多轮对话中逐步学习用户偏好——只不过细节并未公开。

与此不同的是,Letta和LangChain把「记忆回调」的过程完全透明化,方便工程师理解和管理。

AI托管平台Hugging Face的CEO Clem Delangue也强调:

「不仅模型需要开放,记忆系统也必须开放。」

MemGPT则在探索如何把短期与长期记忆区分开,避免AI被「污染」。

这套思路后来被Letta进一步扩展,用在了大规模智能体的「睡眠计算」中。

可以说,「谁先解决记忆问题,谁就更接近下一个AI时代」。

学会遗忘

AI未来的关键一步

在大多数人眼里,AI的进化意味着要「记住更多」。

但Charles Packer却提出另一种思路:

AI不仅要会记,还要学会忘。

在人类世界,遗忘是进化出优势。

研究显示,睡眠中的「智能忘却」能帮助大脑抑制无效信息,把注意力集中在真正重要的片段上。

如果没有遗忘,我们的大脑就会像塞满文件的硬盘,总有一天会崩溃。

而对于AI来说,这是它面临的另一难题:灾难性遗忘(catastrophic forgetting)

因为,AI的神经网络在学习新任务时,往往会覆盖旧知识 。

这和人类的「选择性遗忘」不同,它是一种有层次的、可控的机制。

因此,未来的 AI 需要发展出「人工遗忘」。

当用户对AI说「把那个项目删掉,不要再记了」,未来AI的回应不止是停止调用这段记忆,还能追溯性地清除所有相关内容。

即使是AI,也必须学会删除涉及敏感或过时的信息。

在欧洲,「被遗忘权(Right to Be Forgotten)」已写进隐私法规。

这不仅是技术挑战,更是伦理问题。

那么,谁有权利决定AI记得什么、忘记什么?

当遗忘成为可能,它会带来更安全的使用体验,还是新的操控手段?

或许,真正让AI更像人的,不是「永不遗忘」,而是「学会遗忘」。

参考资料:

https://www.wired.com/story/sleeptime-compute-chatbots-memory/

https://www.fastcompany.com/91368307/why-sleep-time-compute-is-the-next-big-leap-in-ai?utm_source=chatgpt.com

https://www.letta.com/blog/sleep-time-compute?utm_source=chatgpt.com